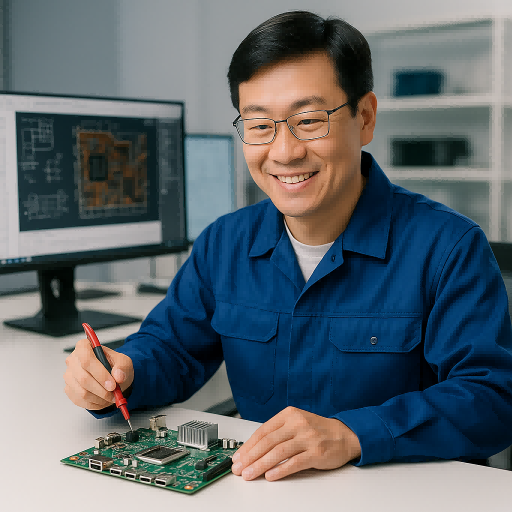

Schede integrate AI Ready per l'intelligenza Edge in tempo reale

In che misura il vostro hardware è in grado di gestire i carichi di lavoro dell'intelligenza artificiale?

Non tutte le schede sono adatte all'intelligenza artificiale. Questa tabella mette a confronto schede embedded standard e soluzioni personalizzate pronte per l'IA, evidenziando come l'I/O di precisione, le capacità di inferenza e la durata sul campo facciano la differenza nell'implementazione di applicazioni reali.

| Domanda | Scheda integrata standard | Scheda personalizzata AI Ready | ODM esclusivo di MiniITXBoard.com |

|---|---|---|---|

| È ottimizzato per l'input visivo? | USB generico, legato alla CPU | Corsie CSI/MIPI sincronizzate | Sincronizzazione multi-camera con trigger hardware |

| Può eseguire l'inferenza in tempo reale? | Necessita di cloud o di una GPU esterna | NPU o VPU integrata | Elaborazione edge Jetson/TPU ottimizzata con pinning BSP |

| Riuscirà a sopravvivere ai siti di intelligenza artificiale? | Dipende dalle ventole e dall'alimentatore | Da -20°C a +70°C, senza ventola | Distinta base sigillata con grado di protezione IP per l'AI sul campo |

| Può funzionare su framework leggeri? | Solo Linux, nessun supporto per lo stack AI | Supporta TensorFlow Lite / ROS2 | Precaricato con JetPack, PyTorch Mobile, Yocto |

Schede AI personalizzate per ogni classe di applicazione

Dalle telecamere intelligenti a basso consumo all'automazione ad alta intensità di GPU, queste categorie aiutano gli acquirenti tecnici ad allineare l'hardware con la complessità dell'intelligenza artificiale, i budget energetici e gli involucri termici.

IA di visione ultracompatta

IA compatta per spazi ristretti e budget di potenza ridotti

Costruito per chioschi intelligenti, edge analytics e inferenza entry-level

Calcolo senza ventole da meno di 10 W con NPU o TPU Coral integrate

Ideale quando lo spazio sulla scheda e i limiti termici sono critici

Utilizzarlo quando:

- È necessaria una visione in tempo reale sotto i 10W

- È necessario essere sempre attivi, ma non connessi al cloud.

- Il vostro fattore di forma è limitato (pinze robotiche, droni)

Gateway di inferenza bilanciati

IA generica per piattaforme mobili e modulari

Potenza di calcolo da 20-60 TOPS

Supporto bilanciato per l'intelligenza artificiale, l'input dei sensori e il networking

Ideale per AGV, robot di ispezione, gateway industriali

Utilizzarlo quando:

- È necessaria un'intelligenza artificiale multi-stream in tempo reale (ad es. fabbriche, AGV).

- Combinate l'intelligenza artificiale, i sensori e il collegamento in rete.

- Sono richiesti un lungo ciclo di vita e un intervallo di temperatura industriale

IA integrata ad alte prestazioni

Ambienti ad alta intensità di intelligenza artificiale, critici per la sicurezza o regolamentati

Costruito con memoria ECC, accelerazione NPU+GPU

Progettato per ospedali intelligenti, nodi di sicurezza, difesa

Elaborazione 24 ore su 24, 7 giorni su 7, con protezioni termiche e failover di alimentazione

Utilizzarlo quando

- Si eseguono più reti neurali in parallelo

- I risultati dell'IA sono mission-critical e legati alla sicurezza

- La conformità (ad es. ISO 26262) è un requisito

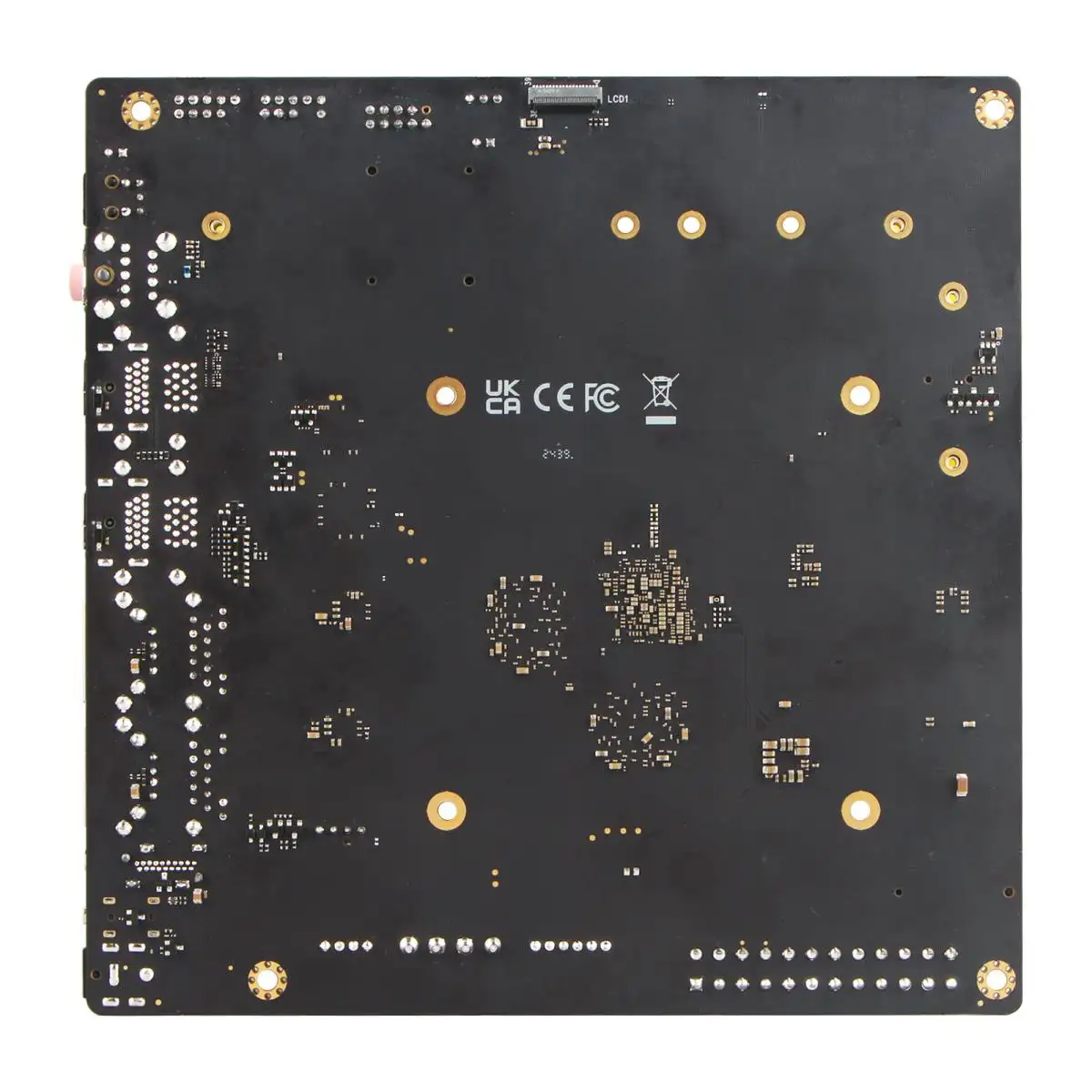

Costruire con fiducia su una piattaforma AI personalizzata

L'implementazione dell'intelligenza artificiale non è generica, e nemmeno l'hardware. Che stiate costruendo sistemi di visione edge multi-camera, robotica autonoma o nodi di analisi in tempo reale, vi aiuteremo a progettare una scheda AI Ready che risponda alle vostre esigenze. Dal layout termico e di alimentazione ai moduli di inferenza e al blocco del ciclo di vita, ottimizziamo per il successo sul campo.

- Supporta moduli NPU/GPU/TPU (Jetson, Coral, Movidius, ecc.)

- Capacità di inferenza AI 24/7 con protezioni termiche e di tensione

- Distinta base e firmware bloccati per garantire la coerenza della produzione

Interfacce di precisione costruite per carichi di lavoro AI

L'inferenza dell'intelligenza artificiale non funziona in modo isolato: si basa su un I/O veloce, sincronizzato e mappato in modo intelligente. Questa sezione spiega come le piattaforme AI Ready sono personalizzate per quanto riguarda l'input dei sensori, l'instradamento del calcolo e la durata dell'implementazione, garantendo che le prestazioni corrispondano alle esigenze delle applicazioni.

| Categoria di interfaccia | Schede Vision AI compatte | Gateway AI di medio livello | Sistemi integrati di intelligenza artificiale avanzati |

|---|---|---|---|

| Interfaccia di acquisizione neurale | CSI-2 x2 con sincronizzazione integrata per la visione di telecamere stereo | CSI-2 x6, matrice di temporizzazione programmabile per ingressi multipli di sensori | CSI-2 x8 con coda di trigger temporizzata AI per l'acquisizione simultanea |

| Percorso di calcolo dell'inferenza | Slot combo USB/NPU per chiamate modello in tempo reale sotto 10W | Corsie PCIe Gen3 + supporto TensorRT locale | Doppia integrazione PCIe Gen4 + GPU per carichi di lavoro AI multi-threaded |

| Logica delle startup AI | Flusso di avvio a rete neurale basato su eMMC | Avvio NVMe con JetPack pre-integrato | Ridondanza dual-boot con supporto watchdog per gli aggiornamenti del firmware AI |

| Controllo e sincronizzazione dei sensori | 4x GPIO con soft interrupt | GPIO abilitato DMA + trigger di blocco I²C | GPIO pronto per la sincronizzazione con latenza di risposta deterministica |

| Display e HMI bordo | HDMI 2.0 o LVDS per l'uscita di stato | HDMI + eDP a doppio canale per cruscotti AI | DSI con capacità HDR per loop di feedback neurale nell'HMI industriale |

| Espansione dell'acceleratore AI | Slot M.2-E o USB per moduli NPU leggeri | Doppio M.2 per SSD + Wi-Fi/NPU ibrido | PCIe x4 per schede GPU, VPU o AI ASIC |

| Interfaccia voce/audio AI | Codec I2S mono per il rilevamento delle parole chiave | Doppio I2S per l'inferenza audio stereo ML | Processore audio DSP con pre-elaborazione vocale intelligente |

| Strato di resilienza energetica | Ingresso 5-12V con blocco per sottotensione | Supporto 9-24V, temprato EMC | Tollerante a 9-36 V, a prova di transitori, pronto per l'hot-swap |

Ingegneria termica e ambientale

Resilienza termica e strategia di alimentazione per le schede edge incentrate sull'IA

L'accelerazione dell'intelligenza artificiale non è solo una questione di potenza di calcolo, ma anche di mantenere i sistemi freddi e stabili quando si tratta di utilizzare i modelli 24 ore su 24, 7 giorni su 7, in ambienti edge. Le schede AI Ready sono progettate per il controllo delle temperature, la regolazione del flusso d'aria e l'alimentazione resistente agli urti, per garantire un'inferenza ininterrotta anche in situazioni imprevedibili del mondo reale.

Raffreddamento a zone per i moduli AI

La suddivisione intelligente in zone calde per GPU/NPU e aree di memoria consente un raffreddamento mirato senza l'uso eccessivo di ventole o condotti.

Design ibrido passivo e attivo

Le schede supportano l'avvio in modalità silenziosa con gli array di heatpipe, aumentando le ventole solo quando i burst di inferenza lo richiedono.

Strozzatura predittiva dell'intelligenza artificiale

I controllori termici integrati reagiscono ai tipi di carico del modello, non solo alle soglie di temperatura, garantendo transizioni fluide sotto pressione in tempo reale.

Ingresso ad ampio range con reset watchdog

Dai robot mobili ai chioschi remoti, tutte le schede supportano un ingresso da 9-36 V CC con filtraggio dei transitori e logica di reset temporizzato.

Testato contro i guasti sul campo

I sistemi sono convalidati per il funzionamento continuo da -20°C a +70°C e tollerano vibrazioni, EMI e fluttuazioni di ingresso senza tempi di inattività.

Resilienza del ciclo di vita per le implementazioni AI-First

Nell'IA edge, le prestazioni del modello sono affidabili quanto la stabilità della scheda nel tempo. Le schede AI Ready sono costruite con una previsione del ciclo di vita, dagli stack firmware congelati ai moduli di inferenza pre-qualificati, per ridurre il rischio di progettazione e garantire un comportamento coerente dell'intelligenza artificiale in ogni fase di implementazione.

Distinta base bloccata per l'integrità del ML

Nessuna sorpresa hardware dell'ultimo minuto. Ogni componente principale (VRM, TPU, circuiti integrati di memoria) è controllato nella versione e congelato nella distinta base per garantire la riproducibilità.

Roadmap di SoC Edge AI convalidate

Le schede sono in linea con le finestre di supporto di oltre 8 anni per piattaforme come Jetson, Coral e EdgeTPU, assicurando la sostenibilità a lungo termine sul campo.

Stack Pinning del driver e dell'IA

SDK pre-qualificati, versioni del runtime Tensor e configurazioni del kernel bloccate in fabbrica per evitare derive durante gli aggiornamenti.

Funzioni del mondo reale abilitate dalle schede AI Ready Mini-ITX

Dai nodi di visione di fabbrica alla robotica mobile e ai chioschi alimentati dall'intelligenza artificiale, le piattaforme AI Ready non si limitano a supportare l'inferenza, ma sono progettate per distribuirla direttamente sul bordo. Di seguito viene illustrato come le nostre schede AI Ready consentono un'elaborazione a bassa latenza, consapevole dei consumi e integrata nei sensori in ambienti critici in tempo reale.

Elaborazione della visione a bordo

Eseguite la classificazione degli oggetti, il rilevamento delle anomalie e il tracciamento in tempo reale a livello locale, su sistemi da meno di 15 W, senza dover ricorrere al cloud.

Decisioni AI offline

Distribuite i modelli YOLO, TensorFlow Lite o ONNX direttamente sulla scheda per supportare il parlato, i gesti e le zone di sicurezza, senza bisogno di internet.

Loop di intelligenza artificiale guidati dai sensori

Integrare senza problemi gli input di telecamere, LiDAR e IMU con attività di ML attivate da GPIO: perfetto per l'automazione di fabbrica, i bot di magazzino e le piattaforme mobili.

L'intelligenza artificiale in ambienti a basso consumo e senza ventola

Le schede supportano l'inferenza completa dei bordi in progetti con vincoli termici. Ideali per chioschi sigillati, carrelli mobili e apparecchiature da campo alimentate a batteria.

Esplorate le intuizioni ingegneristiche per i sistemi embedded pronti per l'intelligenza artificiale

Rimanete informati con conoscenze pratiche di progettazione basate sull'implementazione dell'intelligenza artificiale nel mondo reale. I nostri contenuti editoriali approfondiscono la selezione delle NPU, l'ottimizzazione delle pipeline di visione, la messa a punto degli I/O per i sensori ML e la gestione delle schede AI critiche per il ciclo di vita. Sia che stiate sviluppando sistemi di controllo robotico, unità di ispezione autonome o terminali di visione compatti, il nostro blog fornisce ai buyer tecnici e ai team di ingegneri le indicazioni necessarie per costruire sistemi pronti per l'IA che funzionino sotto pressione.

Intel Celeron N150: bilanciamento di potenza, prestazioni ed efficienza pratica in sistemi compatti

Table of Contents 1. Introduction: The Role of the N150 in Modern Embedded Platforms 2. CPU Microarchitecture and Platform Integration…

Intel Celeron N300: prestazioni a basso consumo per i moderni sistemi embedded

Indice Introduzione: Il posto dell'N300 nei mercati embedded e SFF Architettura e integrazione SoC Consumo di energia e inattività...